Content

The additional costs and administration of quarterly payroll taxes may outweigh any tax savings. It’s essential first to check your any state tax impacts with the Department of Revenue and work with your accountant to run the numbers and be sure the election is worth doing. S corporation status ensures a company is taxed under Subchapter S of Chapter 1 of the Internal Revenue Code (hence, “S corporation.”) This means that the corporation does not pay income taxes. Instead, the company’s profits and losses are divided among the shareholders. These individuals must report this information on their personal tax return, where they are taxed accordingly.

What is 2553 explanation?

Form 2553 is used to tell the IRS that you want a corporation (or entity eligible to be taxed as a corporation, such as a single member LLC) to be taxed as a S-Corp.

Meaning, the inherent personal liability protection is the same for an LLC taxed in its default status or an LLC taxed as an S-Corporation. A late S Corp election form will typically be effective for the tax year following the tax year beginning on the date entered in Part 1 of Form 2553. However, relief for a late election may be available if the corporation can show it had reasonable cause for failing to file on time.

Our Customers Love Using Form Pros

Businesses classified as a C corporation or an LLC can file Form 2553 to benefit from S corporation tax treatment. It’s important to note that an LLC will remain an LLC from a legal standpoint if it elects S corporation status. However, the LLC will be taxed as an S corporation at the federal level. S corporations have regulations on the number of types of shareholders allowed. C corporations allow an unlimited number of shareholders, both foreign- and U.S.-based shareholders, and multiple classes of stock. C corporations can have partnerships and other corporations as shareholders while S corporations cannot.

- Harbor Compliance is not acting as your attorney and does not review information you provide to us for legal accuracy or sufficiency.

- Instead, shareholders report their share of the business’s income or losses on their personal income tax returns, and the income gets taxed at the shareholders’ personal income tax rate.

- Making an S corp election is a fairly simple matter.

- Excellent people, negotiation, and writing skills; keen eye for continuous improvement.

- These are the representations that must be included in either Item I of Part I or in a separate, attached statement.

Past performance is not indicative of future results. Shareholders in an S corp have limited liability protection. If the S corp is sued, the most that a shareholder can lose is the value of the S corp investment. Limited liability means that a business lawsuit does not put a shareholder’s personal assets at risk. Your federal and state taxes will likely be paid quarterly.

Meet some of our IRS Form 2553 Lawyers

We Irs Form 2553 Instructions have the research on all states at this time, so it’s best to reach out to your state’s Department of Revenue and/or an accountant to check. Hope that helps and thank you for your understanding. I opened my new LLC this month, and will be petitioning for S Corp status election next week. What I would like to know is whether there is a chance I can pass my 2020 gains through the LLC and be taxed at the S-Corp rate. In column L, you’re going to list the percentage of ownership and the date which the ownership was acquired.

- Then, if your company has changed its name or address since applying for its EIN, check the appropriate option in box D.

- First, make sure you’re authorized to conduct business transactions on behalf of the corporation.

- Then, with those in hand, return to box I or Part I and explain your reason for filing late.

- The corporation intended to be classified as an S corp as of the intended effective date of the election.

- Editorial content is not those of the companies mentioned, and has not been reviewed, approved or otherwise endorsed by any of these entities.

TheS https://intuit-payroll.org/is an IRS tax classification that allows business owner’s to be taxed under IRS subchapter S instead of as a default LLC or C corporation. Information provided on Forbes Advisor is for educational purposes only. Your financial situation is unique and the products and services we review may not be right for your circumstances. We do not offer financial advice, advisory or brokerage services, nor do we recommend or advise individuals or to buy or sell particular stocks or securities. Performance information may have changed since the time of publication.

See if you’re eligible for business financing

It’s possible to file form 2553 after the deadline, however you won’t be granted S corp status until the following tax year. So if your deadline for S corp election in 2023 is March 15 and you file form 2553 on March 16, 2023, you will not be granted S corp status until 2024. The name of this section can be daunting, but it’s only relevant for trusts applying for S corporation status. If you’re a trust applying for S corp status, list the income beneficiary’s name, address, and social security number, and the trust’s name, address, and employer identification number.

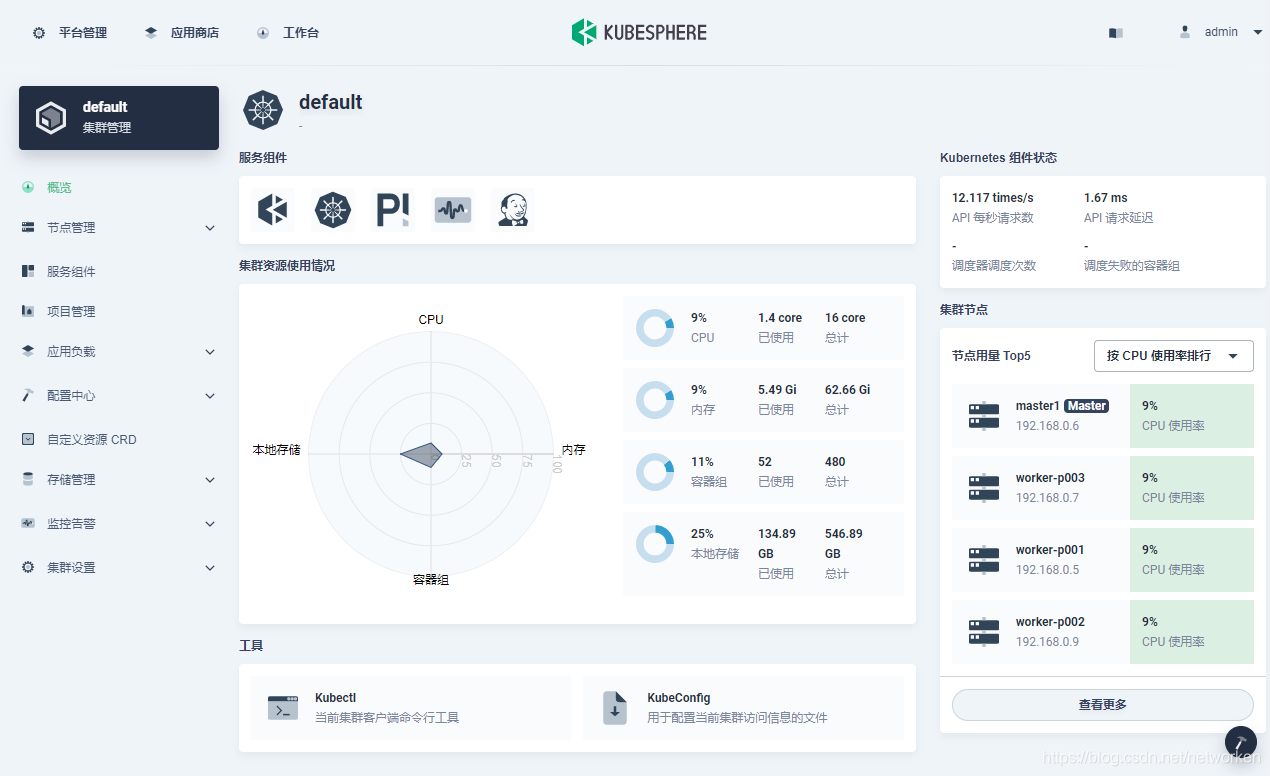

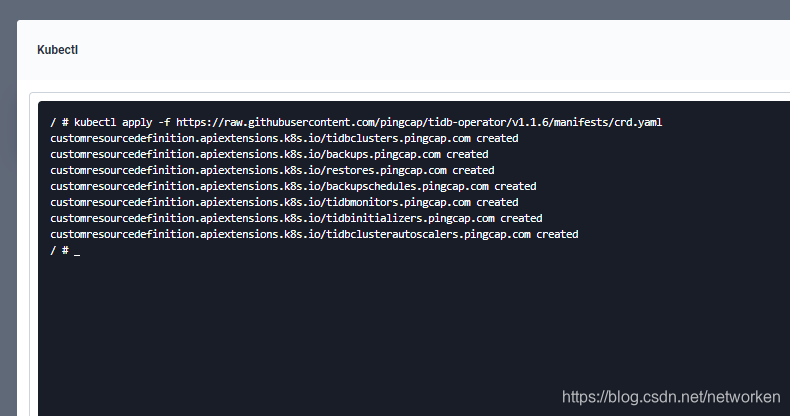

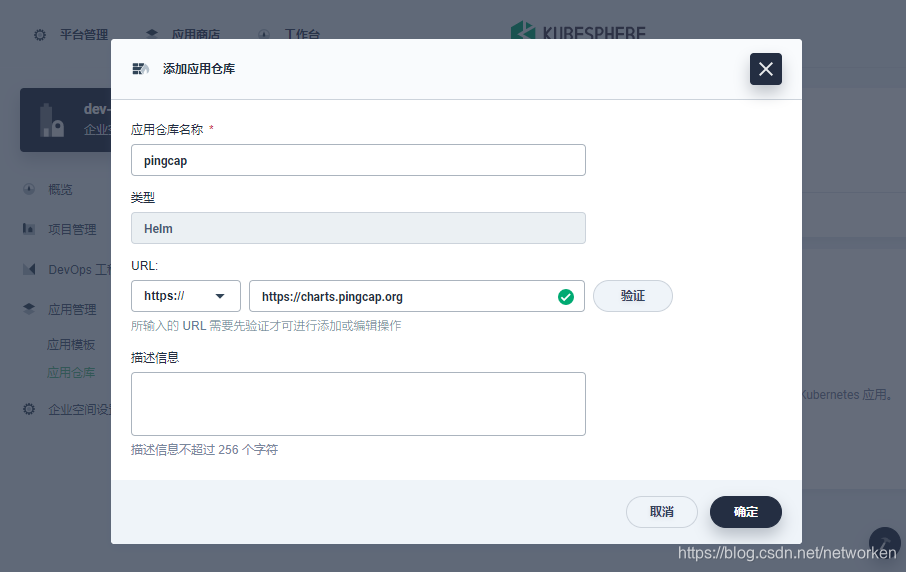

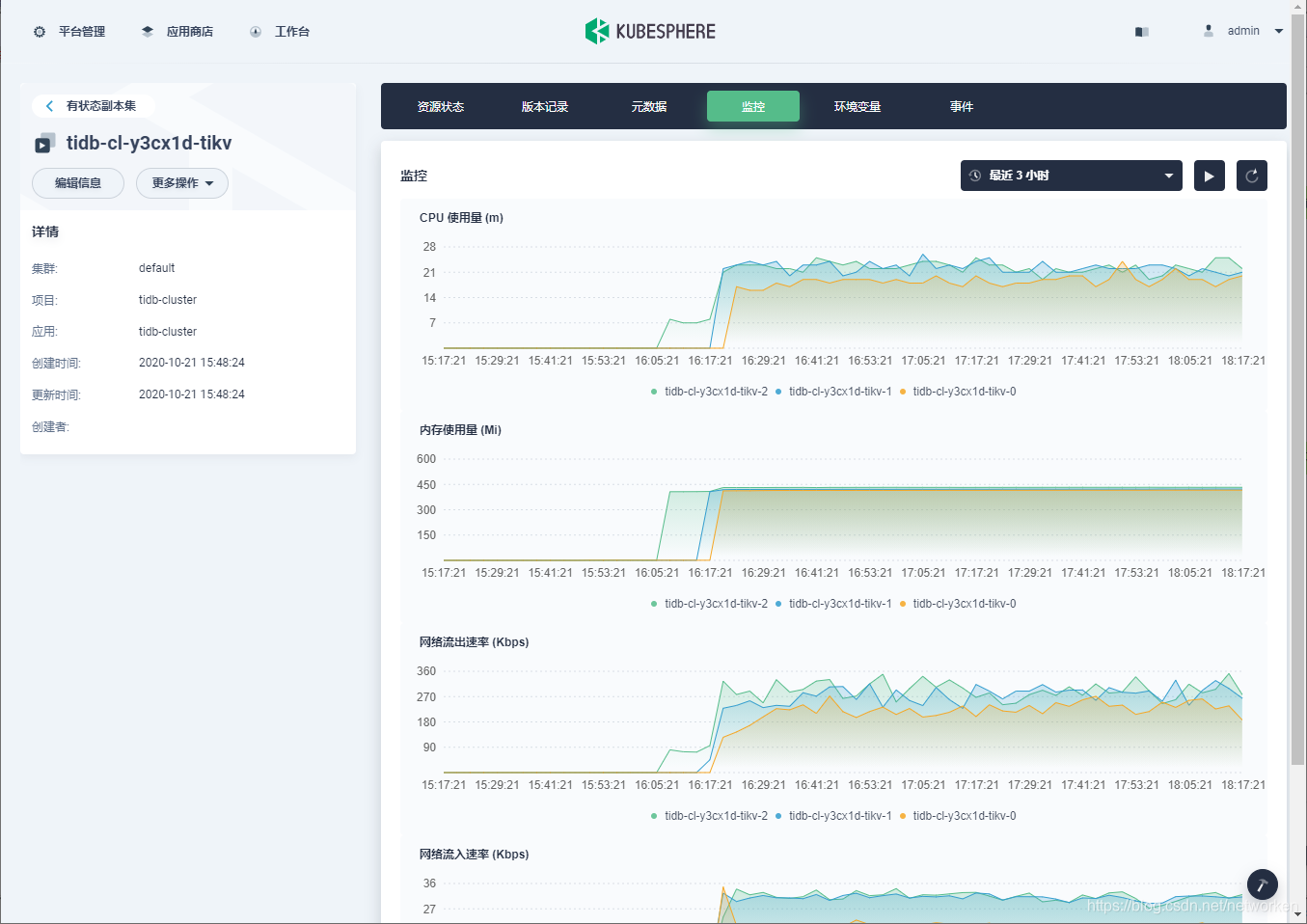

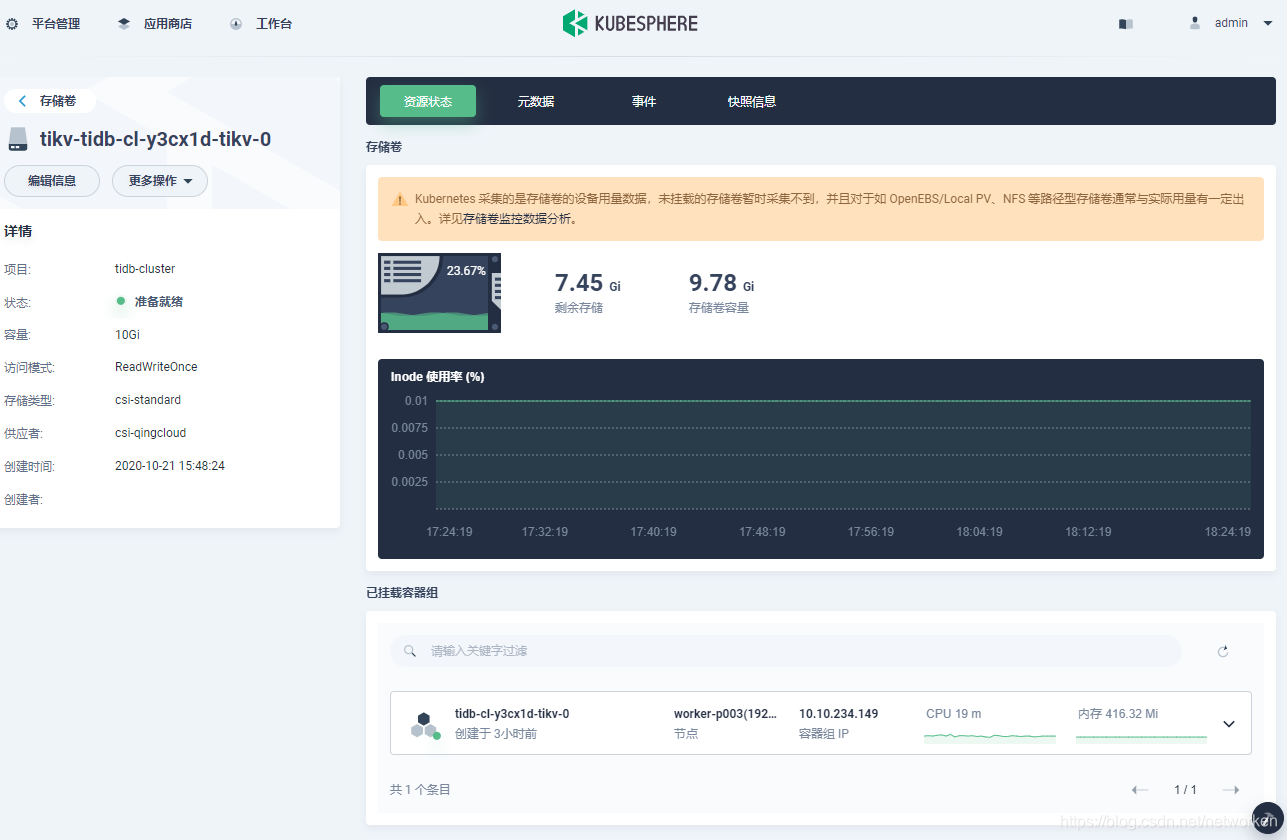

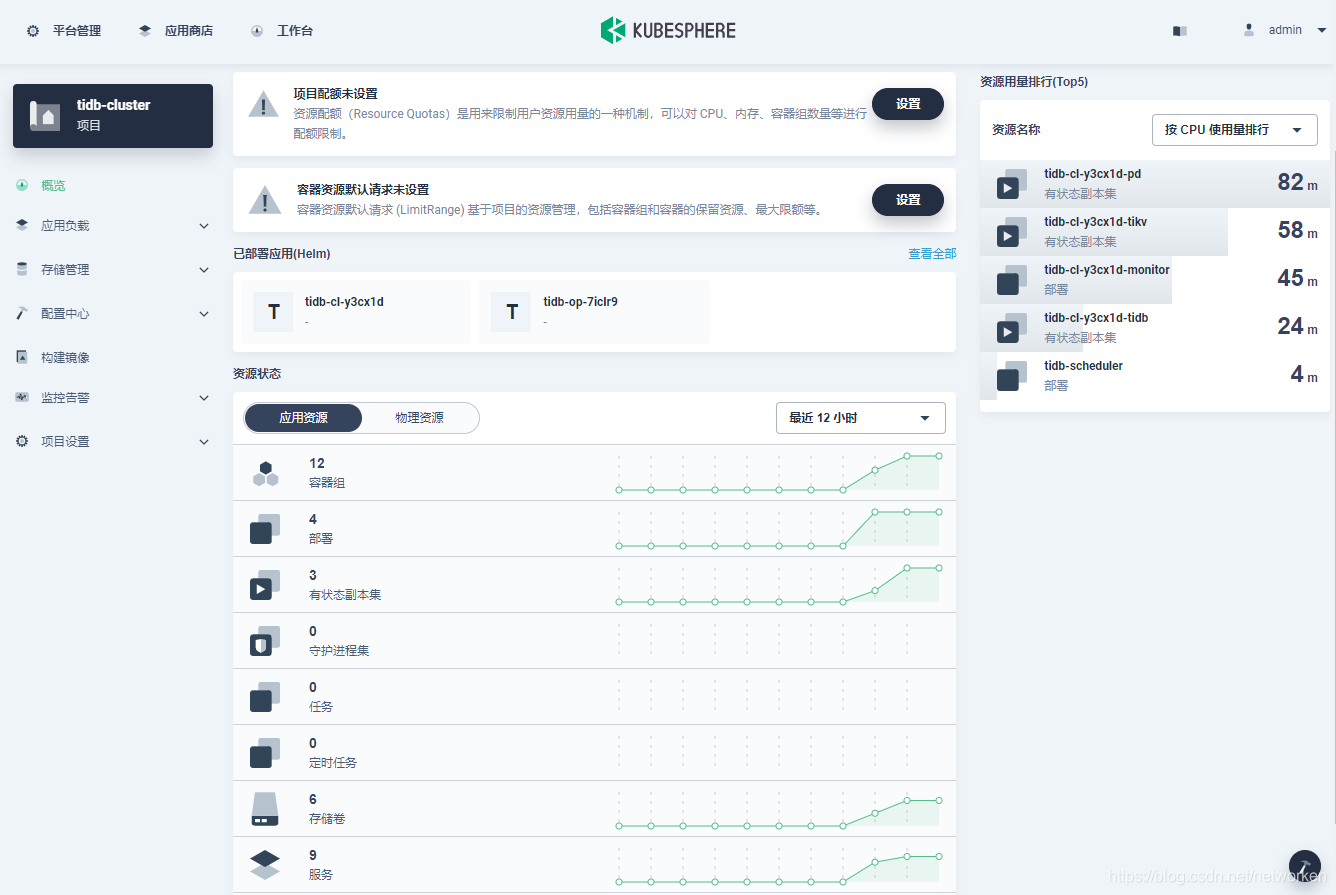

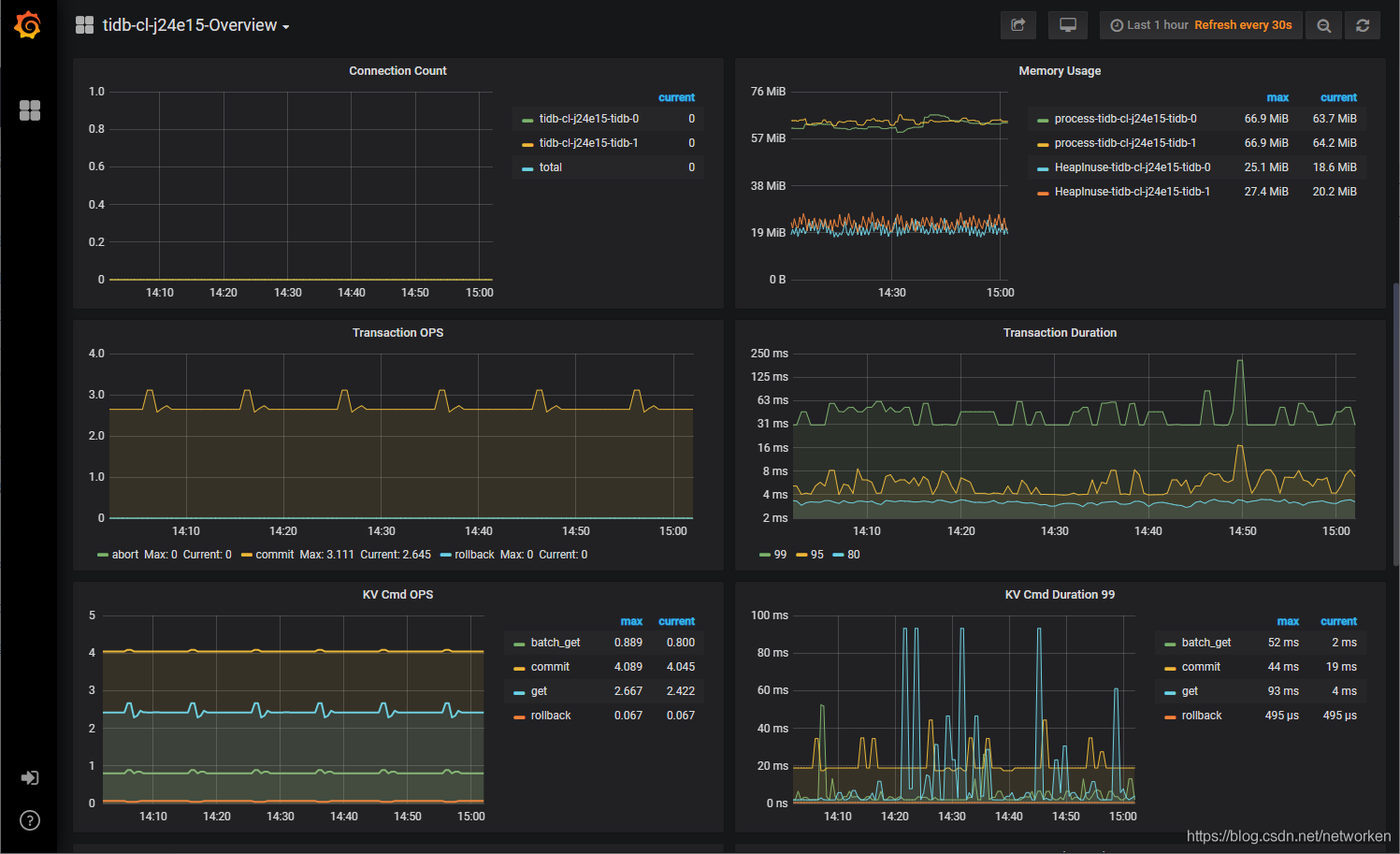

Kubernetes中文社区

Kubernetes中文社区